SimpleGLM的脚本应该如何使用?

首先保证环境安装成功。

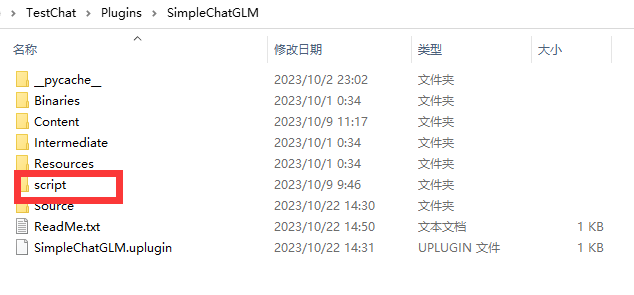

1.来到插件的目录下,找到script脚本:

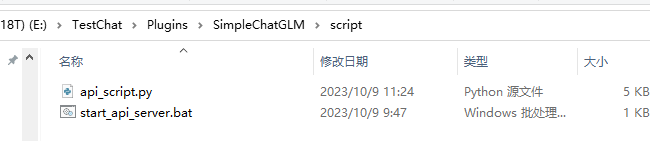

2.打开这个脚本里面的内容:

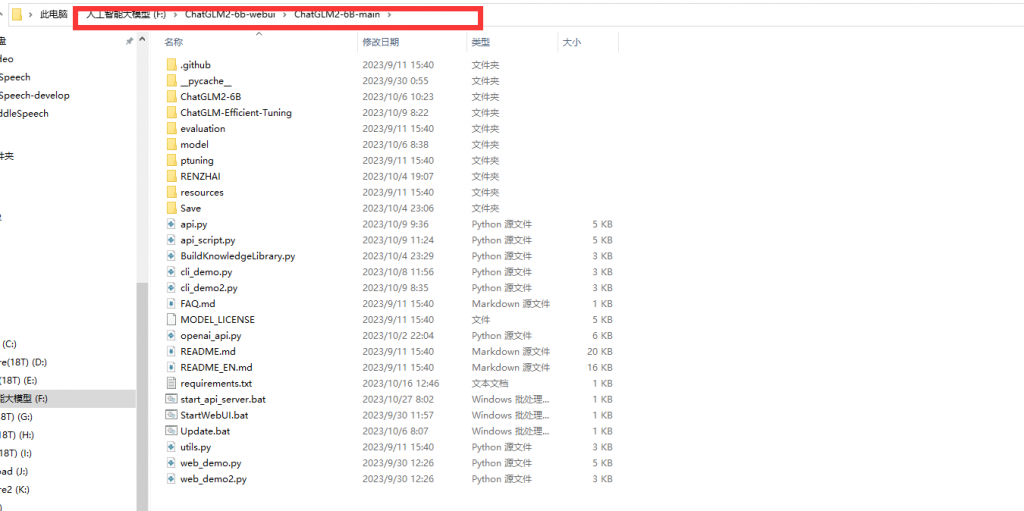

3.将这个脚本里面的内容拷贝到你安装的ChatGLM目录下,比如如下的目录:

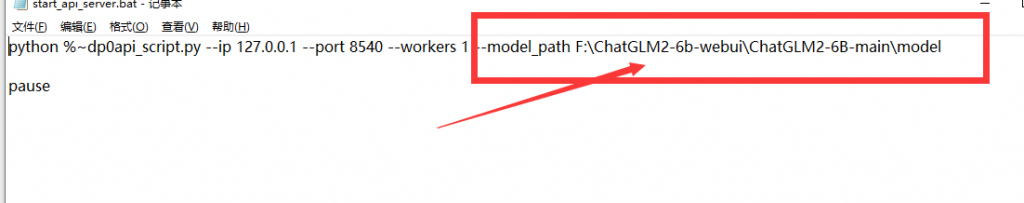

4.用文本的方式打开start_api_server.bat,将里面的–model_path替换成你的模型路径:

完成后直接启动,即可。

如果使用AI自动化安装,无法使用API,请按照以下顺序安装:

1.pip install fastapi

2.pip install transformers -i https://mirror.baidu.com/pypi/simple

3.pip install uvicorn

4.pip install torch (需要开魔法)

5.pip install sse_starlette

6.pip install sentencepiece

7.Torch not compiled with CUDA enabled (去安装cuda) 这个网站下载 :https://pytorch.org/get-started/locally/ (需要开魔法)

2023年10月22 修复编译后无法看到SimpleChatGLM问题,新增了蓝图版本的社区版本。

2024年3月4日 修复SSE流式bug,支持ChatGLM3模型

一.商业版本和学习版本的对比

二.您还未登陆哦

三.该资源出自以下课程

四.相关解决方案

付费版本包含源码,可以二次开发,如果您不需要二次开发,或者想先试用一下,那么我建议先用免费版本,有的免费版本需要登录。

如果免费版本蓝图无法启动,请点击我,里面有解决方案

如果有问题 请加入 售后QQ群:946331852 我们会收集问题,安排维护

如果有希望新增的功能也可以反应到售后,我们会安排添加,感谢理解。

五.社区版本(主要针对不需要登录本站的用户)

需要一个5.1的 不知可否

5.1可以直接用源码版本,如果非UEC++用户,需要编译一下 生成dll

目前chatgml3开源了,这个插件会支持吗?

会的 我们正在支持中